L’essentiel à retenir : l’intégration des modèles de langage transforme la recherche, substituant la synthèse sémantique à l’indexation classique. Cette mutation impose le Generative Engine Optimization pour préserver la visibilité de marque face à l’érosion du trafic. En 2025, l’hégémonie du « Zero-Click » s’établit : 60 % des requêtes Google n’induisent plus aucune navigation externe.

L’érosion brutale de la visibilité organique provoquée par l’impact LLM recherche confronte désormais les organisations à une obsolescence technique majeure de leurs stratégies d’acquisition de trafic traditionnelles. Cette mutation systémique profonde substitue la navigation par liens aux synthèses sémantiques immédiates : l’analyse démontre comment ce basculement vers le Zero-Click redéfinit intégralement le tunnel de conversion classique actuel. L’adoption impérative du Generative Engine Optimization constitue désormais l’unique levier stratégique pour convertir cette friction opérationnelle en une autorité algorithmique durable au sein des nouveaux graphes de connaissances mondiaux et pérenniser durablement la présence digitale.

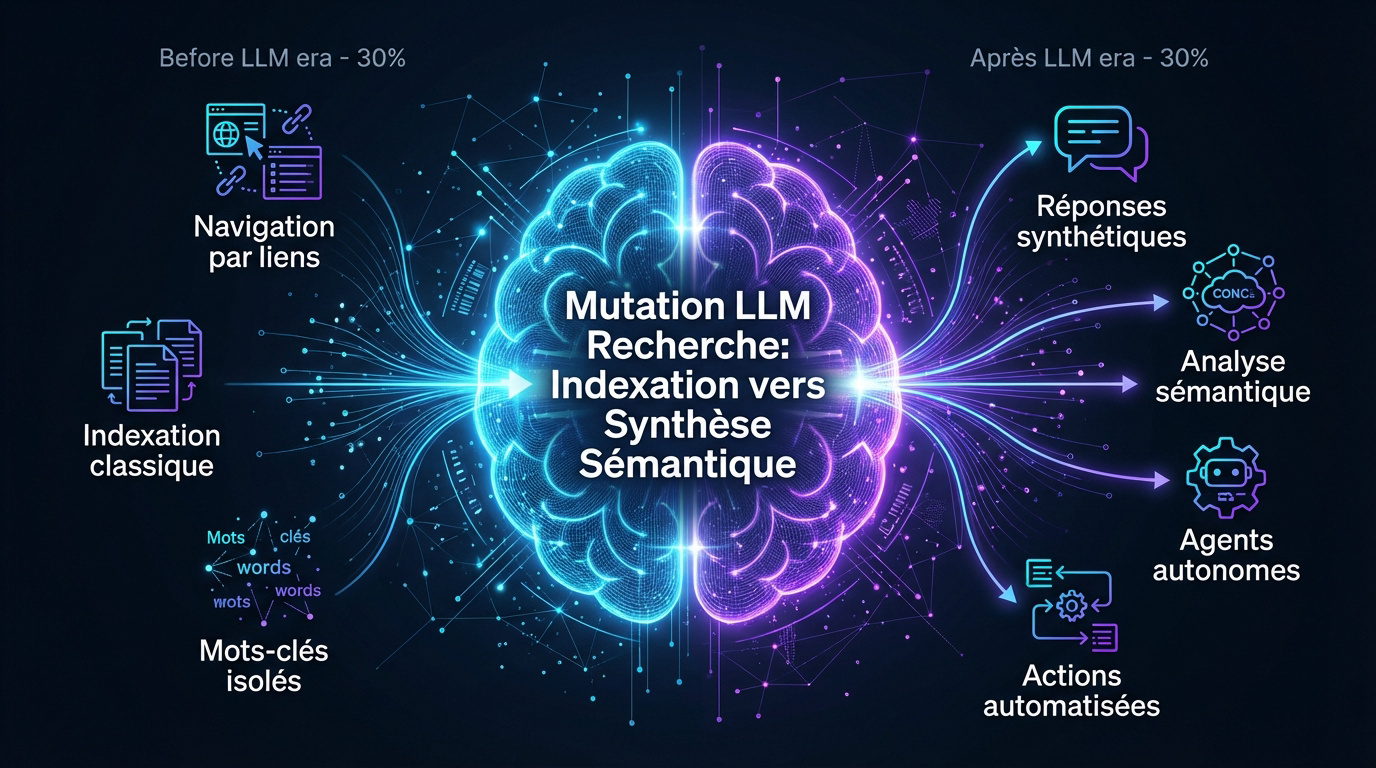

Mutation de l’impact LLM recherche : bascule de l’indexation vers la synthèse sémantique

Après des décennies de domination des moteurs de recherche classiques, l’intelligence artificielle générative redéfinit totalement notre manière d’accéder à l’information en ligne.

Obsolescence de la navigation par liens : l’avènement des réponses synthétiques

L’hégémonie des dix liens bleus s’effondre. Les utilisateurs délaissent l’exploration laborieuse de sites tiers au profit d’une réponse immédiate. Cette fluidité prime désormais sur la navigation fragmentée traditionnelle.

Les AI Overviews orchestrent cette mutation. En agrégeant des données hétérogènes en temps réel, ces systèmes produisent une synthèse consolidée. L’internaute consomme l’information directement sur la page de résultats sans navigation supplémentaire.

L’indexation subit un déclassement structurel. La recherche devient une interaction dialoguée directe avec la machine.

Analyse de l’intention sémantique : le traitement des requêtes conversationnelles complexes

Le paradigme des mots-clés isolés s’efface devant la compréhension contextuelle. L’IA décode l’intention profonde nichée derrière des interrogations complexes. Elle interprète le sens global.

La dépendance aux expressions exactes disparaît. Pour maintenir une visibilité, le contenu doit désormais embrasser des concepts sémantiques vastes. La pertinence se mesure à la densité des vecteurs d’intégration numérique.

Cette transformation du marketing par l’IA impose une restructuration des données. La validation par des tiers devient le levier de crédibilité algorithmique.

Transition vers les agents autonomes : l’automatisation des actions de consommation

L’émergence d’agents capables d’exécuter des tâches marque une rupture. Ces entités ne se limitent plus à l’information : elles réalisent des transactions ou réservations. L’intervention humaine sur les interfaces propriétaires s’amenuise au profit de l’exécution automatisée.

La recherche passive s’éteint. L’individu délègue ses arbitrages à un algorithme comparant les options selon des critères de performance. La machine devient le prescripteur final et souverain de la décision d’achat.

L’interopérabilité technique s’avère vitale. Les marques doivent être parfaitement lisibles pour ces agents décisionnaires autonomes.

Asymétrie de l’expérience utilisateur : fluidification du parcours et opacité pour les marques

Si cette mutation technologique simplifie la vie de l’internaute, elle crée un défi majeur pour les entreprises qui perdent leur visibilité directe au profit des algorithmes. L’article explore comment les modèles de langage de grande taille (LLM) transforment la recherche en ligne, réduisant la friction pour les consommateurs tout en l’augmentant pour les entreprises.

Compression du tunnel de conversion : la fin du parcours client linéaire

L’évaporation des étapes de découverte traditionnelles s’accélère. Les réponses directes absorbent désormais la phase de comparaison. Cela court-circuite violemment le tunnel de vente habituel des sites web classiques.

Le moteur de recherche s’érige en destination finale. L’internaute y trouve l’intégralité des données sans solliciter de lien externe. Ce phénomène de Zero-Click sature l’espace. La navigation vers les domaines tiers devient une relique du passé.

La mémorisation s’étiole. L’utilisateur retient la réponse de l’IA. Il ignore souvent l’identité de la source originelle.

Érosion du trafic organique : les conséquences de la médiation par l’IA

Les taux de clics s’effondrent massivement. Les éditeurs constatent une évaporation de leur audience. L’IA dévore leur substance textuelle pour la restituer sous une forme condensée et désincarnée.

Le contrôle sur la présentation de l’offre disparaît. Les entreprises subissent une médiation opaque. C’est désormais le modèle de langage qui reformule arbitrairement leurs propres arguments commerciaux.

Cette mutation exige de repenser le ROI de l’intelligence artificielle pour maintenir une rentabilité minimale. La visibilité brute ne suffit plus.

Risques de marginalisation algorithmique : le danger de l’invisibilité dans les synthèses

L’absence des bases de données constitue une menace existentielle. Si une marque n’apparaît pas dans la fenêtre de contexte du modèle, son existence commerciale s’annule. Le silence algorithmique équivaut à une disparition pure et simple du marché numérique.

La dépendance envers les systèmes fermés s’accentue. La sélection opérée par les IA devient un rempart infranchissable. Les nouveaux acteurs peinent à briser cette barrière à l’entrée technologique.

Vulnérabilités systémiques s’accumulent :

- Risque de perte de souveraineté

- Dépendance aux API

- Opacité des critères de sélection

Impératifs du Generative Engine Optimization : transition de la persuasion vers la recommandation

Pour survivre à cette opacité, les experts marketing doivent adopter le GEO, une discipline qui privilégie la recommandation algorithmique à la simple persuasion publicitaire.

Notoriété sémantique et récurrence : les nouveaux piliers de la présence machine

L’insertion de mots-clés devient obsolète. La visibilité exige désormais des citations de marque nichées au cœur de thématiques expertes. L’algorithme privilégie la pertinence contextuelle brute plutôt que le simple ciblage lexical.

La fréquence des mentions supplante désormais les liens entrants traditionnels. Une marque citée de manière récurrente par des sources hétérogènes acquiert un statut d’autorité. Les systèmes d’IA transforment ces signaux en recommandations prioritaires.

- Volume de mentions

- Sentiment associé

- Diversité des sources

Branding par recommandation médiatisée : associer concepts et identité de marque

L’ancrage de frameworks propriétaires au nom de l’entreprise s’impose. En structurant des concepts exclusifs, l’entité contraint les modèles de langage à l’identifier comme l’unique source originelle de l’expertise technique.

La production de données primaires assure une mémorisation durable. Devenir le référent statistique garantit une insertion systématique dans les synthèses produites par les systèmes d’intelligence artificielle contemporains.

L’évolution vers l’IA agentique et les relations clients renforce cette autorité. Cette synergie stabilise la présence des marques dans les écosystèmes numériques.

Nouveaux indicateurs de performance : mesurer l’influence au-delà du clic

Le pilotage stratégique repose sur la part de voix générée. Il faut évaluer la fréquence d’apparition de la marque dans les réponses de ChatGPT. Cette comparaison concurrentielle remplace l’analyse du trafic organique.

La visibilité se déplace vers les sources citées. Figurer dans les notes de bas de page des agents conversationnels représente le sommet de l’autorité numérique actuelle.

Les anciens indicateurs comme le taux de clic s’avèrent insuffisants. L’influence réelle se mesure désormais à la mémorisation algorithmique.

Ingénierie de la mémorisation systémique : structuration technique et ancrage de l’autorité

Au-delà de la stratégie de contenu, l’optimisation pour l’IA exige une rigueur technique sans faille pour faciliter l’ingestion des données par les modèles.

Balisage Schema.org et données structurées : faciliter l’ingestion par les modèles

L’architecture technique conditionne la lisibilité algorithmique. Les agents d’entraînement requièrent des structures explicites. Une organisation limpide prévient toute interprétation erronée des spécifications relatives aux services proposés.

L’implémentation de microdonnées fiabilise le décodage sémantique. Le balisage Schema.org fournit un contexte formel. Cette méthode intègre l’entité au sein du graphe de connaissances global. L’IA catégorise alors précisément chaque donnée.

L’optimisation technique hiérarchise les priorités : voici les balises fondamentales.

| Type de donnée | Balise recommandée | Bénéfice IA |

|---|---|---|

| Produit | Product | Précision factuelle |

| Expert | Person | Crédibilité E-E-A-T |

| FAQ | FAQPage | Extraction directe |

| Événement | Event | Visibilité temporelle |

Ancrage dans les graphes de connaissances : construire la marque comme entité

La validation par des tiers fonde la légitimité algorithmique. La cohérence informationnelle entre Wikipedia et LinkedIn s’avère déterminante. Les médias de référence stabilisent l’identité numérique.

Les relations presse digitales alimentent les bases de données externes. Chaque publication sur un domaine d’autorité consolide l’ancrage systémique. La marque devient une entité vérifiable. La fiabilité sémantique en dépend.

L’écosystème externe valide la pertinence : les signaux suivants sont impératifs.

- Relations presse

- Profils experts

- Citations académiques

Valorisation de l’autorité E-E-A-T : lier les experts aux insights stratégiques

La preuve sociale constitue un vecteur de confiance majeur. L’expertise humaine authentifiée influence les systèmes génératifs. Ces modèles privilégient systématiquement les recommandations issues de sources vérifiées.

L’intégration de contenus pédagogiques optimise l’apprentissage machine. Les guides structurés servent de base d’entraînement qualitative. La marque s’impose comme la voix éducative de référence. L’IA relaie ces insights.

La reconnaissance par les pairs garantit la pérennité. L’autorité demeure la priorité des algorithmes.

L’intégration des modèles de langage systématise la synthèse sémantique, substituant la recommandation directe à la navigation classique. Cette mutation impose une transition immédiate vers le Generative Engine Optimization pour préserver l’autorité des marques : la structure technique dicte désormais la visibilité. L’influence future appartient aux sources primaires de l’intelligence.